Einleitung:

Diagnosesicherheit ist ein entscheidender Faktor für die Qualität der Gesundheitsversorgung. Sie bildet die Grundlage für jede weitere therapeutische Maßnahme und ist somit wesentlich für den Erfolg der gesamten Behandlung. Fehldiagnosen, also Fehler, die zu Beginn des Behandlungsprozesses auftreten, haben aufgrund der darauf folgenden fehlerhaft angeordneten Maßnahmen ein hohes Schadenspotenzial. Trotz ihrer Bedeutung ist die systematische, lösungsorientierte Auseinandersetzung mit diagnostischen Fehlern und deren Präventionsmaßnahmen in Praxis und Forschung bislang zu wenig beachtet [1–5]. Die Weltgesundheitsorganisation (WHO) hat aus diesem Grund den diesjährigen Welttag der Patientensicherheit, der seit 2019 jährlich am 17. September eines Jahres begangen wird, unter das Motto „Sichere Diagnose. Richtige Behandlung.“ gestellt, um auf das zugrunde liegende Problem, vor allem aber auch die dafür existenten Lösungen aufmerksam zu machen [6, 7].

Begriffsbestimmungen und Klassifikationen

Diagnostische Fehler lassen sich in verschiedene Kategorien unterteilen. Nach Graber [8] gibt es „schuldlose“ Fehler, kognitiv bedingte Fehler und systemisch bedingte Fehler. Während ein sogenannter „schuldloser“ Fehler beispielsweise bei symptomlosen oder vollkommen atypischen Krankheitsverläufen bzw. bewusst in der Anamnese nicht mitgeteilten Beschwerden vorliegt, kann ein systemisch bedingter Fehler beispielsweise bei einem maschinellen Defekt mit konsekutiver Fehlmessung oder anderen systemischen Defiziten vorliegen (siehe Tab. 1). Beiden Fehlerarten ist gemein, dass sie nur schwer entdeckbar bzw. schwer vermeidbar sind, aber gegenüber kognitiven Fehlern auch seltener vorkommen. Daher widmet sich diese Fortbildung kognitiven Fehlern in diagnostischen Prozessen.

Tab. 1: Beispiele für systembedingte technische und organisatorische Ursachen für diagnostische Fehler nach [8] | |

Fehlerdefinition | Beispiel |

Clustering: Wiederholtes Auftreten der gleichen Fehlerart | Wiederholtes Auftreten von Fehlern bei Röntgenuntersuchungen in der Notaufnahme; Radiologen nicht verfügbar. |

Abläufe, die bestimmte Bedingungen nicht berücksichtigen oder aktiv fehleranfällige Situationen schaffen | Wiederauftretender Dickdarmkrebs wird übersehen: keine Maßnahmen zur Gewährleistung einer regelmäßigen Nachsorge von Patienten nach einer Dickdarmkrebsoperation. |

Ineffiziente Prozesse, die zu unnötigen Verzögerungen führen | Neunmonatige Verzögerung bei der Diagnose von Dickdarmkrebs, was auf zusätzliche Verzögerungen bei der Planung von Klinikbesuchen, Verfahren und Operationen zurückzuführen ist. |

Versäumnis, benötigte Informationen oder Fähigkeiten weiterzugeben | Pathologischer PSA-Werte wurde nicht weitergegeben, sodass keine weiteren therapeutischen Schritte unternommen wurden. |

Versäumnisse bei der Beaufsichtigung von Weiterbildungsassistenten | Verzögerte Diagnose einer Peritonitis: Wiedereinsetzen einer perkutanen Magensonde wurde nicht angemessen beaufsichtigt. |

Technisches Versagen und Ausrüstungsprobleme | Falsche Glukosemesswerte bei falsch kalibrierten Blutzuckermessgerät. |

Bei kognitiven Fehlern hingegen sprechen wir von Fehlern, die aufgrund systematischer Biasformen durch die Denkprozesse des Arztes bzw. der Ärztin verursacht werden. Dazu zählen beispielsweise Fehlinterpretationen von Symptomen oder Untersuchungsergebnissen, das Übersehen relevanter Informationen oder voreilige Schlussfolgerungen [9].

Von Fehldiagnosen sind wiederum Befunderhebungsfehler abzugrenzen, die entweder bedingt sind durch das Unterlassen einer notwendigen Untersuchung oder die Durchführung unnötiger Untersuchungen [10] und an dieser Stelle ausdrücklich nicht thematisiert werden sollen.

Häufigkeit und Auswirkungen von diagnostischen Fehlern

Erhebungen zur Prävalenz diagnostischer Fehler zeigen eine große Heterogenität. In Fachdisziplinen mit hohem Grad an Standardisierung und Homogenität im diagnostischen Ablauf wie der Pathologie oder Radiologie werden Fehlerraten von 2 bis 5 % berichtet. In Fachgebieten wie der Allgemein- oder Notfallmedizin, mit hoher Heterogenität und anderen fehlerbegünstigenden Faktoren, zum Beispiel Zeitdruck, werden international diagnostische Fehler bei 10–15 % aller Fälle beschrieben [11].

Verlässliche Zahlen für Deutschland sind nicht vorhanden. Basierend auf der 2015 vom Institute of Medicine veröffentlichten Publikation „Improving Diagnosis in Healthcare“ ist für den US-amerikanischen Raum allerdings davon auszugehen, dass nahezu jede Person in den USA im Lauf ihres Lebens mindestens einmal Opfer einer medizinischen Fehldiagnose werden wird [12]. Dies zeigt in Übereinstimmung mit Erkenntnissen der Fehlerforschung im therapeutischen Bereich, dass die Rahmenbedingungen, unter denen medizinische Entscheidungen getroffen werden, einen wesentlichen Einfluss auf die Qualität der Entscheidung haben. Fehler müssen nicht durch das Fachgebiet per se bedingt sein.

Die ökonomischen Auswirkungen von Fehldiagnosen sind ebenfalls erheblich, sowohl in Bezug auf die direkten Krankheitskosten als auch durch mögliche finanzielle Aufwände für Haftpflichtversicherungen [13].

Ursachen diagnostischer Fehler

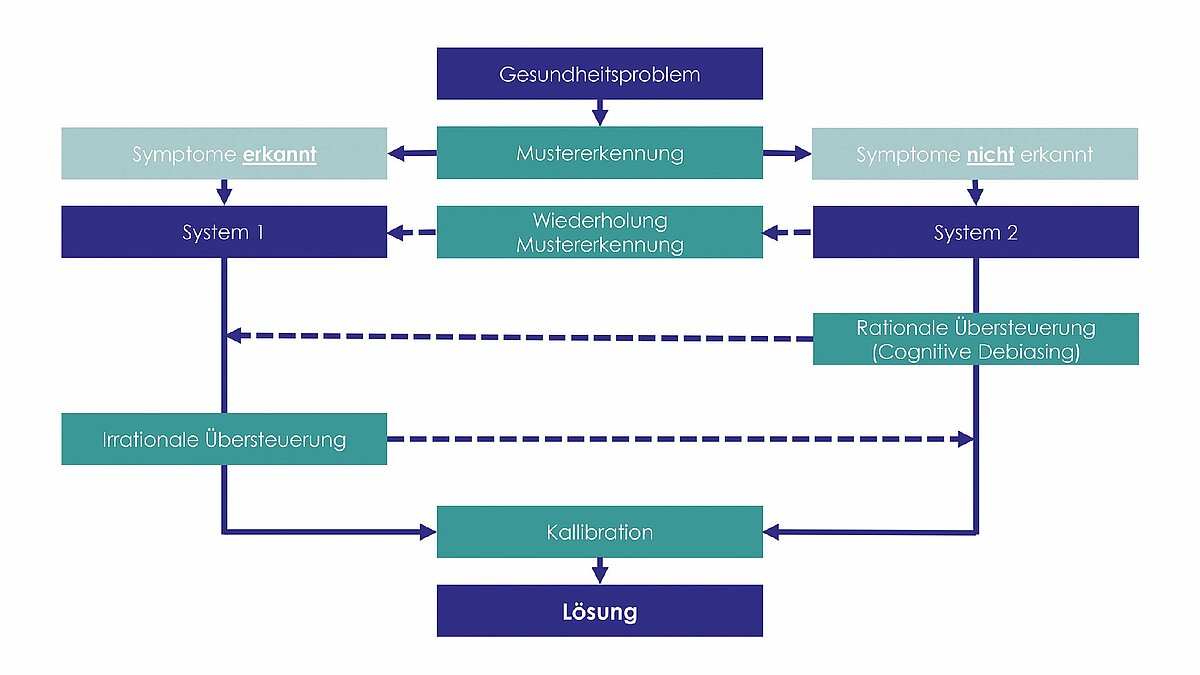

Diagnostische Fehler entstehen häufig durch eine Kombination aus kognitiven und systemischen Faktoren. Der im März diesen Jahres verstorbene Psychologe und Nobelpreisträger für Wirtschaftswissenschaften Daniel Kahnemann beschreibt in seinem Weltbestseller „Thinking, Fast and Slow“ zwei Systeme des Denkens, die eine wesentliche Rolle bei der Entscheidungsfindung spielen:

System 1 und System 2 [14].

System 1 ist das intuitive, schnelle und automatische Denken. Es basiert auf Erfahrungen und Assoziationen und ermöglicht es uns, blitzschnelle Entscheidungen zu treffen, ohne bewusst nachdenken zu müssen. Ein Beispiel für System-1-Denken ist die sogenannte Blickdiagnose, eine Form der diagnostischen Entscheidung, bei der ein erfahrener Arzt oder eine erfahrene Ärztin anhand des bloßen Erscheinungsbildes, der sichtbaren Symptome oder anderer auffälliger Merkmale des Patienten eine Diagnose stellt. Diese Art der Diagnose erfolgt intuitiv und sehr schnell durch Mustererkennung, basierend auf dem umfangreichen Wissen und der Erfahrung des Arztes. Diese Art des Denkens ist effizient, kann jedoch fehleranfällig sein, da sie auf Heuristiken und vereinfachten Entscheidungsregeln basiert [14].

System 2 ist das langsame, analytische und bewusste Denken. Es wird aktiviert, wenn wir komplexe Probleme lösen oder neue Situationen analysieren müssen, wie z. B. bei der Erstellung einer Steuererklärung. System-2-Denken ist gründlich und sorgfältig, aber auch zeitaufwändig und ressourcenintensiv. In der Diagnostik wird dieses System verwendet, wenn die initial ablaufende Mustererkennung der vorhandenen medizinischen Informationen nicht auf dem Weg des Systems 1 zu einer Entscheidung führt und differentialdiagnostische Abwägungen getroffen werden müssen [9, 14] wie in Abbildung 1 dargestellt. Dabei kann sowohl eine System-1-Entscheidung rational als auch eine System-2-Entscheidung irrational überschrieben werden. In solchen Fällen sprechen wir von einem „Bauchgefühl“, welches die rationalen Überlegungen beeinflusst. Dies kann sowohl zur Korrektur einer falschen Entscheidung führen als auch der fehlerhaften Überschreibung einer ursprünglich korrekten Diagnose.

Beide Entscheidungssysteme sind nach Kahnemann ständig aktiv, wobei System 1 aufgrund seiner Geschwindigkeit und Leichtigkeit bevorzugt wird und oft dominiert, während System 2 als Überwachungsinstanz fungiert. Die Herausforderung besteht allerdings darin, dass System-1-Entscheidungen wesentlich anfälliger für systematische Störeinflüsse, sogenannte kognitive Biases sind [15], siehe Abb. 1.

Kognitive Biasformen und Fehldiagnosen

Diagnostische Fehler können entstehen, wenn System-1-Denken durch Automatismen, sogenannte Heuristiken, fehlerhafte Schlussfolgerungen zieht, was auf sogenannte kognitive Biasformen zurückzuführen ist. Zum Beispiel kann die Verfügbarkeitsheuristik dazu führen, dass eine Diagnose gestellt wird, die auf kürzlich gesehenen oder Erinnerungen an besonders eindrückliche Fällen basiert, anstatt auf einer umfassenden Analyse aller verfügbaren Informationen. Ein weiteres Beispiel ist die Ankerheuristik, bei der an einer initialen Diagnose festgehalten wird und neue Informationen, die eine andere Diagnose nahelegen, ignoriert werden. Eine Übersicht dieser und weiterer relevanter kognitiver Biasformen ist in Tab. 2 dargestellt.

Tab. 2: Auswahl an Urteilsheuristiken (aus: [16] basierend auf [9]) | ||

Heuristiken/Biases | Bedeutung | Mögliche Szenarien |

Verfügbarkeitsheuristik Availability heuristic | Die Diagnose wird von den im Gedächtnis verfügbaren und ähnlichen Fällen beeinflusst. | Lendenwirbelsäule-Schmerzen wurden vom Orthopäden als muskuloskelettal interpretiert, allerdings war die Ursache eine Aortenaneurysma-Dissektion |

Ankerheuristik Anchoring effect | Fehlende Fähigkeit, eine initiale Diagnose zu revidieren, trotz neuer Informationen, die eine andere Diagnose vermuten lassen. | Lendenwirbelsäulen-Schmerzen wurden auf eine Kompressionsfraktur zurückgeführt; Fieber und Agitation als Folge der Morphintherapie interpretiert; dabei wurde eine Osteomyelitis nicht diagnostiziert. |

Repräsentativitätsheuristik Attribution bias/ stereotyping | Die Diagnose basiert auf Ähnlichkeitsprinzipien und Vernachlässigung von Basisinformationen. Bei einem bestimmten Patiententyp wird eine bestimmte Diagnose bevorzugt. | Bei einer jungen nervösen Frau mit Gewichtsverlust wurde die Diagnose Anorexia nervosa gestellt; die richtige Diagnose war hingegen Zöliakie. |

Einrahmungseffekt Framing effect | Die Diagnose wird durch das ärztliche Verhalten und die klinische Präsentation bei gleichem Symptom unterschiedlich beeinflusst. | Patient mit Thoraxschmerzen wurde von der Pflegefachfrau der Chest-Pain-Unit als Herzinfarktpatient eingeordnet, sodass der zuständige Arzt auf eine kardiale Diagnose kanalisiert wird. |

Bestätigungsfehler Confirmation bias | Die Diagnose entsteht durch zu starke Gewichtung einer Evidenz, die unsere Diagnose favorisiert, und ignoriert die Informationen, die das Gegenteil beweisen. | Bei einem Diabetiker wurde bei rezidivierendem Erbrechen und bei hohem HbA1c die Diagnose einer diabetischen Gastroparese gestellt; eine Fundoskopie zum Ausschluss eines erhöhten Hirndrucks wurde nicht durchgeführt. |

Selbstüberschätzung Overconfidence | Tendenz zur Überschätzung des eigenen Wissens und Handelns. | Bei einem Patienten mit unklarem abdominalem Infektfokus wurde bei Progredienz in eine Sepsis die antiinfektive Therapie unverändert fortgeführt und auf weitere Diagnostik verzichtet. Im Verlauf war eine notfallmäßige Operation bei perforierter Cholezystitis notwendig. |

Diagnosis momentum | Wenn eine Diagnose gestellt ist, endet auch das Denken. | Bei einem Patienten wird eine Persönlichkeitsstörung festgestellt. Die Klärung einer somatischen Ursache erfolgte erst verspätet: Es wurde ein Tumor des Frontallappens diagnostiziert. |

Vorzeitige Schlussfolgerung Premature closure | Tendenz, vorzeitige Schlussfolgerungen zu ziehen, indem plausible, aber nicht verifizierte Diagnosen akzeptiert und andere, wichtigere Diagnosen nicht gesucht werden. | Bei einer Patientin mit Hinweisen auf ein alveroläres Hämorrhagie-Syndrom bei klinischem Leitsymptom Hämoptoe wird auf eine Thromboseprophylaxe verzichtet. Die alveoläre Blutung war Folge einer Lungenembolie. |

Systemische Faktoren wie Arbeitsüberlastung und mangelnde Verfügbarkeit diagnostischer Tests können die Fehleranfälligkeit von System-1-Denken verstärken. Aber auch unzureichende Koordination/mangelhaftes Follow-up begünstigt die nicht rechtzeitige Diagnosestellung erheblich, wenn Konsultationen nach Untersuchungen beispielsweise verspätet erfolgen, kritische Untersuchungsergebnisse nicht zeitnah aktiv weitergeleitet oder pathologische Befunde zwar erhoben, aber nicht nachverfolgt werden. Diese Form des Informationsverlusts bzw. der verzögerten Weitergabe begünstigt Fehldiagnosen innerhalb einer Organisation oder an Organisations- bzw. Sektorengrenzen in erheblichem Maße [17].

Maßnahmen zur Verbesserung der Diagnosesicherheit

Es gibt verschiedene Ansätze zur Reduktion diagnostischer Fehler. Kognitive Interventionen zielen darauf ab, das Wissen und die Erfahrung der Ärzte zu verbessern, beispielsweise durch Simulationstraining und Feedback auf diagnostisches Denken [1]. Systemische Interventionen umfassen den Einsatz von Checklisten und elektronischen Entscheidungsunterstützungssystemen, die helfen sollen, Fehler im diagnostischen Prozess zu reduzieren [18]. Eine Übersicht über Möglichkeiten zur Reduktion von Fehldiagnosen ist in Tab. 3 aufgeführt.

Tab. 3: Strategien zur Reduktion kognitiver Fehler bei der Diagnosestellung, aus: [19] übersetzt nach: [20], S. 237 |

Klinische Expertise erweitern

|

Systemverbesserung durch Vermeidung kognitiver Prozessfehler

|

Kognitive Herausforderungen durch Hilfen gezielt vermindern

|

Speak up for Patient Safety!

Ein zentraler Aspekt zur Verbesserung der Diagnosesicherheit ist die Etablierung einer Kultur des offenen Dialogs innerhalb des Behandlungsteams. Wenn Teammitglieder die Möglichkeit haben, die Arbeitsdiagnosen ihrer Kolleginnen und Kollegen zu hinterfragen und potenzielle Fehldiagnosen anzusprechen (Speak-up), kann dieser zusätzliche Kontrollmechanismus dazu beitragen, bereits gemachte Fehler frühzeitig zu erkennen und rechtzeitig zu korrigieren.

Dies setzt jedoch eine konstruktive und kollegiale Arbeitsatmosphäre voraus, die in vielen traditionell hierarchischen Systemen fehlt. Nur wenn es erlaubt und sogar erwünscht ist, dass im Behandlungsteam unabhängig von Hierarchiestufe oder Berufsgruppenzugehörigkeit Entscheidungen kritisch hinterfragt werden, kann die Größe des Teams zu einem Sicherheitsfaktor für die Patientenversorgung werden [15]. Ein wichtiger Ansatz ist auch die aktive Einbindung von Patienten und Angehörigen, die durch ihre Rückmeldungen auch im Sinne eines Speak-up zur Fehlervermeidung beitragen können [21].

Fazit

Diagnostische Fehler stellen eine erhebliche Herausforderung für die Gesundheitsversorgung dar. Sie sind häufig, haben ein hohes Schadenspotenzial und verursachen erhebliche Kosten. Durch eine Kombination aus kognitiven und systemischen Interventionen können diese Fehler reduziert und die Diagnosesicherheit verbessert werden. Bereits das Wissen um kognitive Biases sowie eine störungsarme Arbeitsumgebung, die durch systemische Maßnahmen und eine Hinweiskultur fehlervermeidend wirkt, können sowohl die Häufigkeit als auch die Auswirkungen von Fehldiagnosen im Sinne der Patienten- und Mitarbeitersicherheit deutlich vermindern.

Prof. Dr. med. Dipl.-Kfm. Reinhard Strametz

Zum Autor:

Prof. Dr. med. Dipl.-Kfm. Reinhard Strametz hat seit 2013 die Professur für „Medizin für Ökonomen, insbesondere Patientensicherheit“ an der Hochschule RheinMain inne und ist seit 2021 Leiter des Wiesbaden Institute for Healthcare Economics and Patient Safety (WiHelP). Zuvor war er langjährig klinisch als Anästhesist und Notfallmediziner sowie als Ärztlicher Leiter der Stabsstelle Qualitätsmanagement am Universitätsklinikum Frankfurt am Main tätig. Neben zahlreichen Qualifikationen im Qualitäts- und Risikomanagement ist er als Dozent auch für die Landesärztekammer Hessen tätig.

Die Literaturhinweise finden Sie hier.

Fallbericht: Zu schnell im Herzkatheterlabor

Praxisbeispiel eines diagnostischen Fehlers aufgrund kognitivem Bias

Ein 53-jähriger Patient wurde mit akutem Brustschmerz durch den Rettungsdienst in die Notaufnahme eines Krankenhauses der Maximalversorgung gebracht. Anamnestisch waren bereits zwei Myokardinfarkte in der Vorgeschichte bekannt. Der Patient klagte über Brustschmerzen, die in den Arm ausstrahlten und diesmal besonders schlimm waren. In der Notaufnahme wurde keine Zeit verloren und der Patient noch auf der Trage des Rettungsdienstes ins Herzkatheterlabor verlegt, schließlich sollte die Ischämiezeit des Herzens möglichst kurzgehalten werden. Auf dem Untersuchungstisch des Herzkatheterlabors kollabierte der Patient und wurde sofort reanimationspflichtig. Es zeigte sich eine ausgedehnte Aortendissektion. Wir (das Notfallteam, Anm. d. R.) wurden hinzugerufen, den Patienten an die Herz-Lungen-Maschine anzuschließen, um ihn im herzchirurgischen OP einer Notoperation zu unterziehen. Der Patient ist allerdings dabei verstorben. Insbesondere das Team in der Notaufnahme hat sich nachher große Vorwürfe gemacht, da niemand diese Diagnose „auf dem Schirm“ hatte.

Quelle: [15], S. 45/46

Multiple Choice- Fragen

Die Multiple Choice-Fragen zu dem Artikel „Diagnosesicherheit und Fehldiagnosen“ von Prof. Dr. med. Reinhard Strametz finden Sie im Portal sowie in der PDF-Version dieses Artikels. Die Teilnahme zur Erlangung von Fortbildungspunkten ist nur online über das Portal vom 25.08.2024 bis 24.02.2025 möglich. Die Fortbildung ist mit drei Punkten zertifiziert. Mit Absenden des Fragebogens bestätigen Sie, dass Sie dieses CME-Modul nicht bereits an anderer Stelle absolviert haben. Dieser Artikel hat ein Peer-Review-Verfahren durchlaufen. Nach Angaben des Autors sind die Inhalte produkt- und/oder dienstleistungsneutral, es bestehen keine Interessenkonflikte.

Buchtipp:

Reinhard Strametz, Andreas Fidrich: Grundwissen Patientensicherheit. © 2022 Urban & Fischer in Elsevier, 19 €, 124 S. — ISBN: 9783437411731. Alle Autorenhonorare werden dem Aktionsbündnis Patientensicherheit e. V. gespendet. [15]

Patientensicherheit in besonderen Kontexten: Bedürfnisorientierte Versorgung

In der medizinischen Versorgung sind immer wieder Perspektivwechsel nötig, um den Bedürfnissen aller Patienten gerecht werden zu können – so kann auch die Patientensicherheit von allen Beteiligten gefördert werden. In der aktuellen Veranstaltung aus der Live-Online-Fortbildungsreihe „Patientensicherheit und Qualitätssicherung“ der Akademie für Ärztliche Fort- und Weiterbildung der Landesärztekammer Hessen (LÄKH) am 18. September 2024 von 16:45–21 Uhr soll der Fokus daher auf: „Patientensicherheit in besonderen Kontexten: Bedürfnisorientierte Versorgung“ liegen.

Die Themen reichen vom Umgang mit Sehbeeinträchtigung im Krankenhaus über die Förderung von interkulturellem Verständnis bis hin zu den speziellen Erfordernissen im Umgang mit seltenen Erkrankungen. Fatma Köksal, Dr. agr. Dr. med. Rahim Schmidt und Prof. Dr. med. Jürgen Schäfer werden dazu referieren.

Kooperationspartner sind neben der Stabsstelle Qualitätssicherung der LÄKH die Hessische Krankenhausgesellschaft und das Universitätsklinikum Frankfurt.

Die Veranstaltung mit Workshop richtet sich an Ärzte, Patientensicherheitsbeauftragte und weitere Interessierte aus dem Gesundheitswesen. Die CME-Zertifizierung und die Anerkennung als Fortbildung gemäß § 2 Abs. 5 Patientensicherheitsverordnung wird angestrebt. Informationen: https://kurzlinks.de/llbx

| Live-Online Fortbildungsveranstaltung „Patientensicherheit und Qualitätssicherung“ | |

| Termine: | Mi. 18. September 2024, 16:45–21 Uhr Mi. 19. März 2025, 16:45–21 Uhr |

| Information und Anmeldung: | Christina Ittner, Fon: 06032 782-223, E-Mail: christina.ittner@laekh.de www.akademie-laekh.de |